1. 加速跑

spark-sql --name uername --num-executors 21 --driver-memory 8G --executor-memory 8G

2. 上传数据

- 建表

create table xxx_yyy ( userid varchar(200))

- 上传数据

load data local inpath '/home/spark/xxx.txt' into xxx_yyy ##inpath后面跟路径名,into后面跟表名

3. 导出数据

hive -e "select * from temp.user_temp;" > /home/spark/temp/daochu.txt ##通过hive的导出,代码尽量从中间表出,短代码没问题,但是越长越会出现问题。

4. 建表语句

create table table_name ( column1 double comment '字段注释1', column2 double comment '字段注释2' )partitioned by (data_date string) row format delimited fields terminated by '\t' stored as textfile ; ---创建新表

insert overwrite table table_name partition(data_date)

drop table if exists table_name; create table if not exists table_name as ..... ---更好的建表方式

5. MAC上的数据加密打包工作

##STEP 1 首先开启终端机(Terminal),使用 cd 指令切换到要压缩的档案所在目录,如果放在桌面上就是: cd Desktop ##STEP 2 ##使用 zip 指令配合 -e 参数制作加密的压缩档: zip -e daobao.zip daobaowenjian.txt ##其中 daobaowenjian.txt 就是要加密压缩的档案,而 daobao.zip 就是输出的压缩档档名。 ##在压缩前,要先输入密码: ##如果要压缩整个资料夹,就把上面的 filetoprotect.txt 替换成资料夹,再加上 -r即可,例如: zip -er ~20180115.zip ~/20180115/ zip -er 20180115.zip 20180115

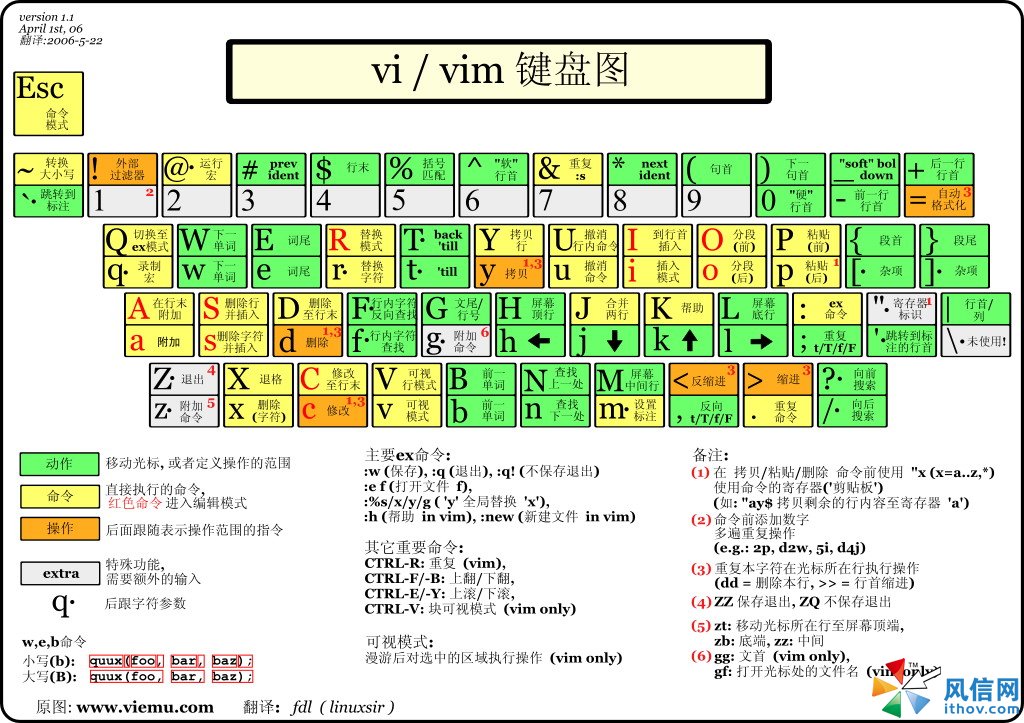

6. VIM的常用快捷键

7. UDF的使用

add jar /home/script_job/jar/hive-udf-1.0.jar; create temporary function month_end as 'com.xxx.hive_udf.EndDayOfMonth';

8. MAC上用终端快速链接跳板机访问spark

vi ~/.bash_profilealias work="ssh user_name@172.0.0.0"

##保存后可在终端直接输入work进行访问