单拿标题来讲,看来有点装x,但是没有恶意,知识记录自己的学习过程,希望能碰到一些志同道合的人,一起讨论。

首先,我们要理解:什么是hadoop?给人的第一感觉就一个字“云”,似乎带着点神奇的色彩,不可否认hadoop有他独特的地方,但也没那么神乎其神。他是一个开源框架,可以编写和运行分布式应用处理大规模数据,通过建立hadoop集群和运行一些mapred例子,我所感到只有就个字:“方便”、“健壮”、“可扩展”、“简单”。hadoop自身带有文件系统,可以处理大规模数据,相比较下:

会和sql数据库有什么区别呢?

1.随着数据量的增大,提高数据库配置的开销越来越大,2倍于pc机的服务器的价格远远高于2台pc机的价格,这就是hadoop的优势,增加一个电脑(节点),要比一次服务器升级划算的多。

2.用键值代替了关系表,个人感觉在大规模数据面前的数据处理,键值对跟为灵活。

如何理解hadoop的mapreduce:

这里有一篇文章 我觉得很有意思:这里提供个连接供大家学习 我是如何向老婆解释MapReduce的?

概念性的东西听着有些乏味:下面我们动手改一个自己的mapreduce程序:

我们都知道hadoop自带例子中有一个wordcount的例子,下面我们就改写这个例子,执行一个属于我们自己的mapreduce程序;

1、首先要找到wordcount的源代码,在hadoop目录下的src/examples/org/apache/hadoop/examples/WordCount.java

2、创建文件夹并且把wordcount文件拷出来:

mkdir playground

mkdir playground/src

mkdir playground/classes

cp src/examples/org/apache/hadoop/examples/WordCount.java playground/src/WordCount.java

3、在hadoop框架中编译和执行这个副本

javac -classpath hadoop-0.20.2-core.jar:lib/commons-cli-1.2.jar -d playground/classes/ playground/src/WordCount.java

[liye@test237 hadoop-0.20.2]$ jar -cvf playground/wordcount.jar -C playground/classes/ .

标明清单(manifest)

增加:org/(读入= 0) (写出= 0)(存储了 0%)

增加:org/apache/(读入= 0) (写出= 0)(存储了 0%)

增加:org/apache/hadoop/(读入= 0) (写出= 0)(存储了 0%)

增加:org/apache/hadoop/examples/(读入= 0) (写出= 0)(存储了 0%)

增加:org/apache/hadoop/examples/WordCount.class(读入= 1911) (写出= 996)(压缩了 47%)

增加:org/apache/hadoop/examples/WordCount$IntSumReducer.class(读入= 1789) (写出= 746)(压缩了 58%)

增加:org/apache/hadoop/examples/WordCount$TokenizerMapper.class(读入= 1903) (写出= 819)(压缩了 56%)

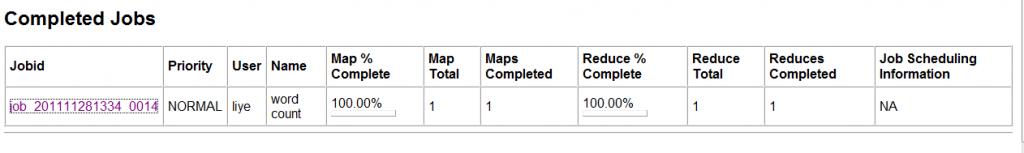

4、运行你的程序,出现如下信息说明执行成功:

[liye@test237 hadoop-0.20.2]$ bin/hadoop jar playground/wordcount.jar org.apache.hadoop.examples.WordCount input my_output

11/12/05 21:33:30 INFO input.FileInputFormat: Total input paths to process : 1

11/12/05 21:33:31 INFO mapred.JobClient: Running job: job_201111281334_0014

11/12/05 21:33:32 INFO mapred.JobClient: map 0% reduce 0%

11/12/05 21:33:41 INFO mapred.JobClient: map 100% reduce 0%

11/12/05 21:33:53 INFO mapred.JobClient: map 100% reduce 100%

11/12/05 21:33:55 INFO mapred.JobClient: Job complete: job_201111281334_0014

11/12/05 21:33:55 INFO mapred.JobClient: Counters: 17

11/12/05 21:33:55 INFO mapred.JobClient: Job Counters

11/12/05 21:33:55 INFO mapred.JobClient: Launched reduce tasks=1

11/12/05 21:33:55 INFO mapred.JobClient: Launched map tasks=1

11/12/05 21:33:55 INFO mapred.JobClient: Data-local map tasks=1

11/12/05 21:33:55 INFO mapred.JobClient: FileSystemCounters

11/12/05 21:33:55 INFO mapred.JobClient: FILE_BYTES_READ=25190

11/12/05 21:33:55 INFO mapred.JobClient: HDFS_BYTES_READ=44253

11/12/05 21:33:55 INFO mapred.JobClient: FILE_BYTES_WRITTEN=50412

11/12/05 21:33:55 INFO mapred.JobClient: HDFS_BYTES_WRITTEN=17876

11/12/05 21:33:55 INFO mapred.JobClient: Map-Reduce Framework

11/12/05 21:33:55 INFO mapred.JobClient: Reduce input groups=1857

11/12/05 21:33:55 INFO mapred.JobClient: Combine output records=1857

11/12/05 21:33:55 INFO mapred.JobClient: Map input records=734

11/12/05 21:33:55 INFO mapred.JobClient: Reduce shuffle bytes=25190

11/12/05 21:33:55 INFO mapred.JobClient: Reduce output records=1857

11/12/05 21:33:55 INFO mapred.JobClient: Spilled Records=3714

11/12/05 21:33:55 INFO mapred.JobClient: Map output bytes=73129

11/12/05 21:33:55 INFO mapred.JobClient: Combine input records=7696

11/12/05 21:33:55 INFO mapred.JobClient: Map output records=7696

11/12/05 21:33:55 INFO mapred.JobClient: Reduce input records=1857

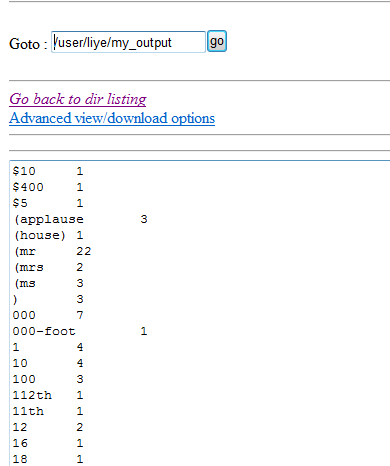

5、查看结果,在文件系统的my_output中

6、最后大家可以任意更改wordcount.java里面的文件,达到自己想要的效果。