Ubuntu16.05 �°�װhadoop��α�ֲ�ʽ��������

һ����

1����ubuntu�նˣ�����hadoop�û�

$ sudo useradd -m hadoop -s /bin/bash #����hadoop�û�����ʹ��/bin/bash��Ϊshell

$ sudo passwd hadoop #Ϊhadoop�û��������룬֮����Ҫ����������������

$ sudo adduser hadoop sudo #Ϊhadoop�û����ӹ���ԱȨ��

$ su - hadoop #�л���ǰ�û�Ϊ�û�hadoop

$ sudo apt-get update #����hadoop�û���apt,�������İ�װ

2��װSSH,����SSH�������½

$ sudo apt-get install openssh-server #��װSSH server

$ ssh localhost #��½SSH����һ�ε�½����yes

$ exit #�˳���¼��ssh localhost

$ cd ~/.ssh/ #���û�������Ŀ¼��ִ��һ��ssh localhost

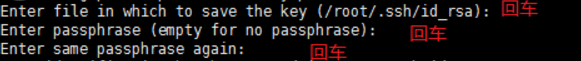

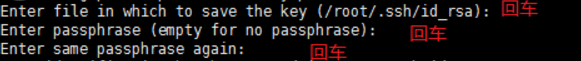

$ ssh-keygen -t rsa����

������ $ ssh-keygen -t rsa������Ժ���Ҫ�����û����λس�������ͼ��

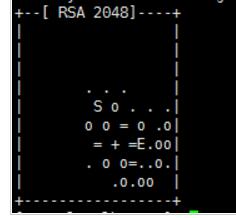

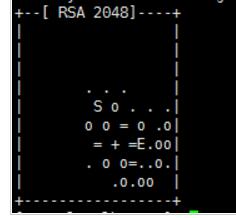

���У���һ�λس�����KEY����Ĭ��λ�ã��Է���������������롣�ڶ��κ͵�������ȷ��passphrase������Բ������λس���������Ժ����������������ͼ��ʾ����������ɹ���

֮�������룺

$ cat ./id_rsa.pub >> ./authorized_keys #������Ȩ

$ ssh localhost #��ʱ�Ѳ������뼴�ɵ�¼localhost�����ɼ���ͼ�����ʧ�����������SSH�������¼��Ѱ���

������װjdk1.8

������oracle��������jdk1.8 https://www.oracle.com/technetwork/java/javase/downloads/jdk8-downloads-2133151.html ���������а�װ�뻷���������ã����ݸ��˵���ϵͳѡ���Ӧ�汾����ѡ����jdk-8u201-linux-x64.tar.gz

����ͼ��ʾ

�������jdk��ѹ���ò�����

$ sudo mkdir /usr/lib/jvm #����jvm�ļ���

$ sudo tar zxvf jdk-8u201-linux-x64.tar.gz -C /usr/lib/jvm #/ ��ѹ��/usr/lib/jvmĿ¼��

$ cd /usr/lib/jvm #�����Ŀ¼

$ sudo mv jdk1.8.0_201 java #������Ϊjava

$ sudo vi ~/.bashrc #��JDK���û�������

ע���������Ȩ�������������Ŀ¼�´���jvm�ļ��У���ô����ʹ�� $ sudo -i ������root�˻��������ļ��С�

�����Ƽ�ʹ��vim���༭���������������һ��ʹ��ָ��

$ sudo vim ~/.bashrc

���û��vim,����ʹ�ã�

$sudo apt-get install vim

���������ء�

��.bashrc�ļ���������ָ�

export JAVA_HOME=/usr/lib/jvm/java

export JRE_HOME=${JAVA_HOME}/jre

export CLASSPATH=.:${JAVA_HOME}/lib:${JRE_HOME}/lib

export PATH=${JAVA_HOME}/bin:$PATH

����ͼ��ʾ��

���ļ�������Ժ�������룺

$ source ~/.bashrc #ʹ�����õĻ���������Ч

$ java -version #����Ƿ�װ�ɹ����鿴java�汾

�����������ͼ��ʾ�����ݣ���Ϊ��װ�ɹ�

������װhadoop-2.9.2

������hadoop-2.9.2.tar.gz����������:

http://archive.apache.org/dist/hadoop/core/stable/

����ͼѡ�����ļ��������أ�

������а�װ��

$ sudo tar -zxvf hadoop-2.9.2.tar.gz -C /usr/local #��ѹ��/usr/localĿ¼��

$ cd /usr/local

$ sudo mv hadoop-2.9.2 hadoop #������Ϊhadoop

$ sudo chown -R hadoop ./hadoop #���ļ�Ȩ��

��hadoop���û���������������������ӵ�.bashrc�ļ�:

export HADOOP_HOME=/usr/local/hadoop

export CLASSPATH=$($HADOOP_HOME/bin/hadoop classpath):$CLASSPATH

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin

����ͼ��ʾ

ͬ����ִ��source ~/.bashrcʹ������Ч�����鿴hadoop�Ƿ�װ�ɹ�������ͼ��ʾ��

�ġ�α�ֲ�ʽ����

Hadoop �����ڵ��ڵ�����α�ֲ�ʽ�ķ�ʽ���У�Hadoop �����Է���� Java ���������У��ڵ����Ϊ NameNode Ҳ��Ϊ DataNode��ͬʱ����ȡ���� HDFS �е��ļ���Hadoop �������ļ�λ�� /usr/local/hadoop/etc/hadoop/ �У�α�ֲ�ʽ��Ҫ��2�������ļ� core-site.xml �� hdfs-site.xml ��Hadoop�������ļ��� xml ��ʽ��ÿ������������ property �� name �� value �ķ�ʽ��ʵ�֡����Ƚ�jdk1.8��·����export JAVA_HOME=/usr/lib/jvm/java�����ĵ���һ���Ѿ����úã�����������Ҫ�˶��£����ӵ�hadoop-env.sh�ļ�

�������£�

$ cd /usr/local/hadoop/etc/hadoop/ # �л��������ļ�Ŀ¼

$ sudo vim hadoop-env.sh # ���ļ����鿴����·��

��������Ӧ�þ��ɣ���������ע���˵����ַ�ʽ����һ��û�ɹ����ij���һ�ֺ���ͳɹ��ˡ�So�������Ƽ����õ����ְɣ���

��������core-site.xml�ļ���

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>

�������������ļ� hdfs-site.xml

<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/name</value>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/data</value>

</property>

</configuration>

Hadoop �����з�ʽ���������ļ������ģ����� Hadoop ʱ���ȡ�����ļ�������������Ҫ��α�ֲ�ʽģʽ�л��طǷֲ�ʽģʽ����Ҫɾ�� core-site.xml �е���������⣬α�ֲ�ʽ��Ȼֻ��Ҫ���� fs.defaultFS �� dfs.replication �Ϳ������У��ɲο��ٷ��̳̣���������û������ hadoop.tmp.dir ��������Ĭ��ʹ�õ���ʱĿ¼Ϊ /tmp/hadoo-hadoop�������Ŀ¼������ʱ�п��ܱ�ϵͳ�����������±�������ִ�� format ���С��������ǽ��������ã�ͬʱҲָ�� dfs.namenode.name.dir �� dfs.datanode.data.dir�������ڽ������IJ����п��ܻ������

������ɺ�ִ�� NameNode �ĸ�ʽ��

$ hdfs namenode �Cformat # hadoop namenode �Cformat Ҳ����

ִ�к���ʾ�������£�

������ʾ����������һЩ��Ϣ��Ȼ�����һ����Ҫ����ȷ�ϲ�����Y or N ������Y������ͼ��ʾ��

����namenode��datanode���̣����鿴�������

$ start-dfs.sh

$ jps

������ɺ���ͨ������ jps ���ж��Ƿ�ɹ����������ɹ���������г����½���: ��NameNode������DataNode�� �� ��SecondaryNameNode��

��ʱҲ�п��ܳ���Ҫ������localhost�������� �������ʱ�������������ȷ������ȴ�������룬��ԭ������������������û�����ʱ��Ĭ�ϵ���root�û������ǰ�ȫ�ڼ�ssh����Ĭ��û�п�root�û���sshȨ��

������룺

$sudo vim /etc/ssh/sshd_config

���PermitRootLogin �����Ƿ�Ϊyes��������ǣ����д��� ��PermitRootLogin ���������ɾ������Ϊyes�����档֮���������д�������SSH����

$sudo /etc/init.d/sshd restart

�����������루�������¼�ο���һ�£�

�ɹ��������Է��� Web ����http://localhost:50070�鿴 NameNode �� Datanode ��Ϣ�����������߲鿴 HDFS �е��ļ���

���ˣ�hadoop�İ�װ���Ѿ��������

enjoy it��

�ο���ַ��https://www.cnblogs.com/87hbteo/p/7606012.html