目录:

- Spark简介

- Spark特点

- Spark环境搭建

- Spark简单使用

- idea创建sprak项目

- Spark运行模式

- Spark基础架构

一.Spark简介

1.官网:http://spark.apache.org/

2.

3.

二.Spark特点

三.Spark环境搭建

安装步骤:

- 安装的spark版本为 spark-1.6.0,根据文档搭建spark运行环境

- 搭建Spark开发环境:提前安装Java 7+、Hadoop 2.6.0+ 、Python 2.6+ 、Scala 2.10.x,版本如

- 安装Java:Linux下安装Java(JDK8)

- 安装Hadoop:hadoop-2.7.3的安装

- 安装Python:http://www.runoob.com/python/python-install.html

- 安装Scala:linux下安装scala

- 下载Spark-1.6.0:官网下载链接

- 上传

- 解压

- 配置环境变量

- 修改配置文件

第一步:在conf目录下复制并重命名 spark-env.sh.template 为spark-env.sh

执行:

cp spark-env.sh.template spark-env.sh

vim spark-env.sh

第二步:在spark-env.sh中添加

-

export JAVA_HOME=/home/jdk1.7.0_80

SPARK_MASTER_IP=localhost

SPARK_WORKER_MEMOR=1G

- 启动和测试

启动:因为提前了安装了hadoop,而hadoop的启动命令也是start-all.sh,所以进入spark的安装目录下/sbin/start-all.sh下执行

验证是否可以web访问:

crul http://192.168.200.10:8080/

四.Spark简单使用

使用:

- 创建hello.txt文件,并写入内容

- 使用Spark - shell

- 测试

五.idea创建sprak项目

简要步骤:

说明:

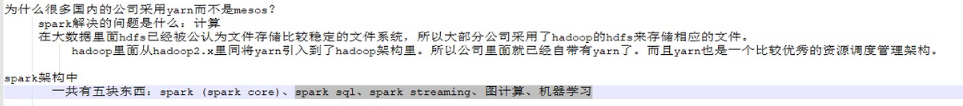

六.Spark运行模式

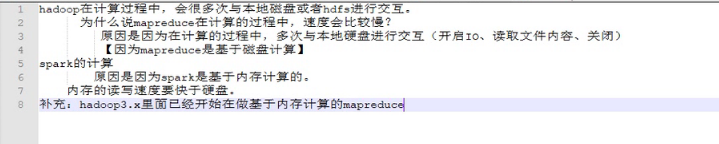

七.Spark基础架构