版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/wangyang163wy/article/details/88179798

案例三:Flume 监听本地目录,并将目录下文件上传至 HDFS

创建配置文件

1.在这里,我使用 Flume 监听的是 /usr/wang/data/upload 目录下的文件

2.在 flume 的 conf 同级目录下创建 job 文件夹,并在 job 文件夹内创建 flume-dir-hdfs.conf

cd /usr/wang/flume

mkdir job

cd job

vim flume-dir-hdfs.conf

将下方文件拷贝到 flume-dir-hdfs.conf 中

a1.sources = r1

a1.sinks = k1

a1.channels = c1

# Describe/configure the source

a1.sources.r1.type = spooldir

a1.sources.r1.spoolDir = /usr/wang/data/upload

a1.sources.r1.fileHeader = true

#忽略所有以.tmp结尾的文件,不上传

a1.sources.r1.ignorePattern = ([^ ]*\.tmp)

# Describe the sink

a1.sinks.k1.type = hdfs

a1.sinks.k1.hdfs.path = hdfs://master:9000/flume/upload/%Y%m%d/%H

#上传文件的前缀

a1.sinks.k1.hdfs.filePrefix = upload-

#是否按照时间滚动文件夹

a1.sinks.k1.hdfs.round = true

#多少时间单位创建一个新的文件夹

a1.sinks.k1.hdfs.roundValue = 1

#重新定义时间单位

a1.sinks.k1.hdfs.roundUnit = hour

#是否使用本地时间戳

a1.sinks.k1.hdfs.useLocalTimeStamp = true

#积攒多少个Event才flush到HDFS一次

a1.sinks.k1.hdfs.batchSize = 1000

#设置文件类型,可支持压缩

a1.sinks.k1.hdfs.fileType = DataStream

#多久生成一个新的文件

a1.sinks.k1.hdfs.rollInterval = 600

#设置每个文件的滚动大小

a1.sinks.k1.hdfs.rollSize = 134217700

#文件的滚动与Event数量无关

a1.sinks.k1.hdfs.rollCount = 0

#最小冗余数

a1.sinks.k1.hdfs.minBlockReplicas = 1

# Use a channel which buffers events in memory

a1.channels.c1.type = memory

a1.channels.c1.capacity = 1000

a1.channels.c1.transactionCapacity = 100

# Bind the source and sink to the channel

a1.sources.r1.channels = c1

a1.sinks.k1.channel = c1

注意上方的 a1.sinks.k1.hdfs.path 中的 hdfs 端口号应该与你在 hadoop 下的 core-site.xml 中配置的 NameNode 的地址相同,之前因为端口号不正确,会在 log 日志中出现 connect refused

<configuration>

<!-- 指定HDFS中NameNode的地址 -->

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<!-- 指定Hadoop运行时产生文件的存储目录 -->

<property>

<name>hadoop.tmp.dir</name>

<value>/usr/wang/hadoop/data/tmp</value>

</property>

</configuration>

测试

1.在执行监控配置之前,需要先将 HDFS 集群启动起来

cd /usr/wang/hadoop/sbin

./start-dfs.sh

2.执行监控配置

cd /usr/wang/flume

bin/flume-ng agent --conf conf/ --name a1 --conf-file job/flume-file-hdfs.conf

3.查看 HDFS 上是否创建成功

/usr/wang/hadoop/bin/hdfs dfs -ls /flume

4.查看本地的被监控文件夹

另注:在这个过程中,当我在 /usr/wang/data/upload 文件夹下创建 hello.txt 并向其中写入数据,保存关闭后,Flume同样会将 hello.txt 这个文件上传至 HDFS

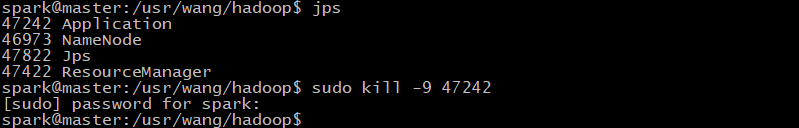

5.关闭

在执行监控配置端输入 ctrl + c 即可关闭,或者直接使用

sudo kill -9 进程号