1.Kafka

kafka��һ����Դ�ķֲ�ʽ��Ϣϵͳ����linkedinʹ��scala��д������LinkedIn�Ļ����Activity Stream������Ӫ���ݴ����ܵ���Pipeline���Ļ��������и�ˮƽ��չ����������

1.1 kafka�����Ŀ��

1.����������

2.���ݴ��̳־û�����Ϣ�����ڴ���cache��ֱ��д�뵽���̣�������ô��̵�˳���д���ܡ�

3.zero-copy������IO�������衣

4.֧�������������ͺ���ȡ��

5.֧������ѹ����

6.Topic����Ϊ���partition����߲��д���������

1.2 ��ظ���

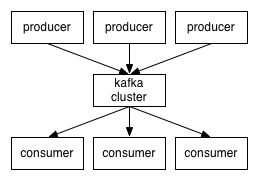

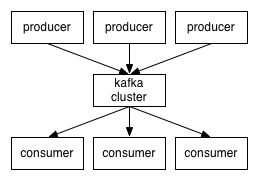

1.Producer ����Ϣ�����ߣ�������kafka broker����Ϣ�Ŀͻ��ˡ�

2.Consumer ����Ϣ�����ߣ���kafka brokerȡ��Ϣ�Ŀͻ���

3.Topic ������,�����Ϣ�ĵط�,��������Ϊһ�����С�

4.Consumer Group ��CG����������.����kafka����ʵ��һ��topic��Ϣ�Ĺ㲥���������е�consumer���͵�������������һ��consumer�����ֶΡ�һ��topic�����ж��CG��topic����Ϣ�Ḵ�ƣ�������ĸ��ƣ��Ǹ����ϵģ������е�CG����ÿ��CGֻ�����Ϣ������CG�е�һ��consumer�������Ҫʵ�ֹ㲥��ֻҪÿ��consumer��һ��������CG�Ϳ����ˡ�Ҫʵ�ֵ���ֻҪ���е�consumer��ͬһ��CG����CG�����Խ�consumer�������ɵķ��������Ҫ��η�����Ϣ����ͬ��topic��

5.Broker ��һ̨kafka����������һ��broker��һ����Ⱥ�ɶ��broker��ɡ�һ��broker�������ɶ��topic��

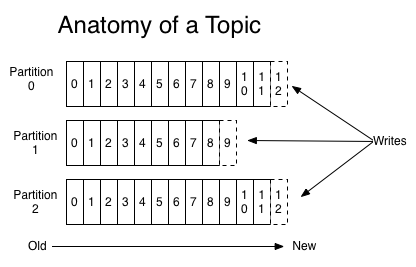

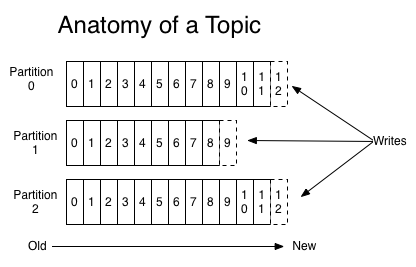

6.Partition������. һ��Topic�е���Ϣ���ݰ��ն��������֯��������kafka��Ϣ������֯����С��λ��һ���������Կ�����һ��FIFO�� First Input First Output����д�������ȳ����У��Ķ��С�Ϊ��ʵ����չ�ԣ�һ���dz����topic���Էֲ������broker�������������ϣ�һ��topic���Է�Ϊ���partition��ÿ��partition��һ������Ķ��С�partition�е�ÿ����Ϣ���ᱻ����һ�������id��offset����kafkaֻ��֤��һ��partition�е�˳����Ϣ����consumer������֤һ��topic�����壨���partition�䣩��˳��

7.Offset����Ϣƫ����.kafka�Ĵ洢�ļ����ǰ���offset.kafka����������offset�����ֵĺô��Ƿ�����ҡ�����������λ��2049��λ�ã�ֻҪ�ҵ�2048.kafka���ļ����ɡ���Ȼthe first offset����00000000000.kafka

1.3 kafka�ܹ�

1.4 Topic������ܹ�

1.5 kafka��Ⱥ(һ̨�������)

ǰ��:

kafka��Ⱥ����zookeeper��Ⱥ,���Ա���Ҫ����zookeeper��Ⱥ.�ɲο��ҵ���һƪ����:<<��һ̨���������zookeeper��Ⱥ>>

��������: cenos7�����һ̨, kafka_2.12-2.1.0.tar.gz

Kafka���ص�ַ: http://kafka.apache.org/downloads

����:

����kafka�ļ���,�ϴ���װ��

cd /usr/dev-soft && mkdir kafka && cd kafka

rz,ѡ��װ���ϴ�

��ѹ

tar �Czxvf kafka_2.12-2.1.0.tar.gz

����3��������Ϣ���ļ���

mkdir kafka-logs-1 kafka-logs-2 kafka-logs-3

�������ļ�server.properties

vi kafka_2.12-2.1.0/config/server.properties

����ģʽ������ :set nu��ʾ�к�

��:

��21��: broker.id=1

��31��: listeners=PLAINTEXT://192.168.81.128:9091

��36��: advertised.listeners=PLAINTEXT://192.168.81.128:9091

��60��: log.dirs=/usr/dev-soft/kafka/kafka-logs-1

��123��: zookeeper.connect=192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183

����һ��kafkaӦ���������.���μ�Ⱥʹ��3��kafkaӦ��,����2��,�ļ���.

����:

������,����2��

mv kafka_2.12-2.1.0 kafka_2.12-2.1.0-1

cp �Cr kafka_2.12-2.1.0-1 kafka_2.12-2.1.0-2

cp �Cr kafka_2.12-2.1.0-1 kafka_2.12-2.1.0-3

�ڶ�̨��server.properties

vi kafka_2.12-2.1.0-2/config/server.properties

��:

��21��: broker.id=2

��31��: listeners=PLAINTEXT://192.168.81.128:9092

��36��: advertised.listeners=PLAINTEXT://192.168.81.128:9092

��60��: log.dirs=/usr/dev-soft/kafka/kafka-logs-2

����̨��server.properties

vi kafka_2.12-2.1.0-3/config/server.properties

��:

��21��: broker.id=3

��31��: listeners=PLAINTEXT://192.168.81.128:9093

��36��: advertised.listeners=PLAINTEXT://192.168.81.128:9093

��60��: log.dirs=/usr/dev-soft/kafka/kafka-logs-3

Kafka��Ⱥ�������.

2.5.1����&�رռ�Ⱥ

��д�����ű�(��ʵ������������3��kafka)

cd /usr/dev-soft/kafka

vim kafka-start.sh

��������:

cd kafka_2.12-2.1.0-1

bin/kafka-server-start.sh -daemon config/server.properties

cd ../kafka_2.12-2.1.0-2

bin/kafka-server-start.sh -daemon config/server.properties

cd ../kafka_2.12-2.1.0-3

bin/kafka-server-start.sh -daemon config/server.properties

cd ../

ͬ���رսű�����:

vim kafka-stop.sh

д���������ݣ�

kafka_2.12-2.1.0-1/bin/kafka-server-stop.sh

kafka_2.12-2.1.0-2/bin/kafka-server-stop.sh

kafka_2.12-2.1.0-3/bin/kafka-server-stop.sh

���θ���ִ��Ȩ��

chmod u+x kafka-start.sh

chmod u+x kafka-stop.sh

����kafka��Ⱥ:��ע��Ҫ������zookeeper��Ⱥ��

./ kafka-start.sh

�������е���,�ԵȺ�,����jps����鿴���:

����˵�������ɹ���,������Ҫ������Ϣ֤����Ⱥ�Ŀ�����,�ڴ�֮ǰ,��Ҫ�Ȱ�9091,9092,9093�������˿ڶ����,��Ϣ�ķ��ͺ���ȡ����ͨ����Щ�˿ڵ�.

ִ����������:

���Ŷ˿�:

firewall-cmd --zone=public --add-port=9091/tcp �Cpermanent

firewall-cmd --zone=public --add-port=9092/tcp �Cpermanent

firewall-cmd --zone=public --add-port=9093/tcp --permanent

��������ǽ��

firewall-cmd --reload

�鿴�˿ں��Ƿ�����

firewall-cmd --query-port=9091/tcp

firewall-cmd --query-port=9092/tcp

firewall-cmd --query-port=9093/tcp

2.5.2 ������Ϣ&������Ϣ

��һ��kafkaӦ���ϲ�������

cd /usr/dev-soft/kafka/ kafka_2.12-2.1.0-1

����topic:kafkatest

bin/kafka-topics.sh --create --zookeeper 192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183 --replication-factor 2 --partitions 2 --topic kafkatest

�鿴topic:

ij��topic

bin/kafka-topics.sh --describe --zookeeper 192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183 --topic kafkatest

ȫ��topic

bin/kafka-topics.sh --list --zookeeper 192.168.81.128:2181,192.168.81.128:2182,192.168.81.128:2183

������Ϣ:

bin/kafka-console-producer.sh --broker-list 192.168.81.128:9091,192.168.81.128:9092,192.168.81.128:9093 --topic kafkatest

������Ϣ:

����һ������:

cd /usr/dev-soft/kafka/ kafka_2.12-2.1.0-1

bin/kafka-console-consumer.sh --bootstrap-server 192.168.81.128:9091,192.168.81.128:9092,192.168.81.128:9093 --from-beginning --topic kafkatest

3.ʹ��Java���뷢��,������Ϣ

ʹ��Springboot��Ŀ����,Springboot�Ѿ�������kafka,���������dz���.

3.1 pom.xml

<xml version="1.0" encoding="UTF-8">

<project xmlns="http://maven.apache.org/POM/4.0.0" xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<parent>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-parent</artifactId>

<version>2.1.1.RELEASE</version>

<relativePath/> <!-- lookup parent from repository -->

</parent>

<groupId>com.mlsama</groupId>

<artifactId>kafka</artifactId>

<version>1.0.0</version>

<name>kafka</name>

<description>Demo project for Spring Boot</description>

<properties>

<java.version>1.8</java.version>

</properties>

<dependencies>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-web</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka</artifactId>

</dependency>

<dependency>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-starter-test</artifactId>

<scope>test</scope>

</dependency>

<dependency>

<groupId>org.springframework.kafka</groupId>

<artifactId>spring-kafka-test</artifactId>

<scope>test</scope>

</dependency>

<!--lombokԼ��-->

<dependency>

<groupId>org.projectlombok</groupId>

<artifactId>lombok</artifactId>

</dependency>

<!--�ռ�-->

<dependency>

<groupId>org.slf4j</groupId>

<artifactId>log4j-over-slf4j</artifactId>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.springframework.boot</groupId>

<artifactId>spring-boot-maven-plugin</artifactId>

</plugin>

</plugins>

</build>

</project>

3.2 application.properties

#�Ķ˿�

server.port=8899

#springMVC������

#��ͼǰ

spring.mvc.view.prefix=/html/

#��ͼ��

spring.mvc.view.suffix=.html

#kafka�������

spring.kafka.bootstrap-servers=192.168.81.128:9091,192.168.81.128:9092,192.168.81.128:9093

#����һ��Ĭ����

spring.kafka.consumer.group-id=0

#key-value���л������л�

spring.kafka.consumer.key-deserializer=org.apache.kafka.common.serialization.StringDeserializer

spring.kafka.consumer.value-deserializer=org.apache.kafka.common.serialization.StringDeserializer

spring.kafka.producer.key-serializer=org.apache.kafka.common.serialization.StringSerializer

spring.kafka.producer.value-serializer=org.apache.kafka.common.serialization.StringSerializer

#ÿ������������Ϣ������

spring.kafka.producer.batch-size=12800

spring.kafka.producer.buffer-memory=102400

3.3 KafkaProduct.Class

@RestController

@Slf4j

public class KafkaProduct {

@Autowired

private KafkaTemplate<String, String> kafkaTemplate;

@GetMapping("/index")

public String kafka(){

return "kafka";

}

/**

* ������Ϣ��kafka��Ӧ��topic

* @param topic

* @param message

*/

@RequestMapping("/kafka/sendMessage")

public String sendMessage(@RequestParam("topic")String topic, @RequestParam("message")String message) {

try {

ListenableFuture<SendResult<String, String>> send = kafkaTemplate.send(topic, 0,System.currentTimeMillis(),"test",message);

send.addCallback(new SuccessCallback() {

@Override

public void onSuccess(@Nullable Object obj) {

SendResult<String, String> sendResult = (SendResult) obj;

//...

log.info("��Ϣ���ͳɹ�:{}", sendResult);

}

}, new FailureCallback() {

@Override

public void onFailure(Throwable throwable) {

log.info("��Ϣ����ʧ��,case:{}", throwable);

//ʧ�ܴ���

}

});

return "��Ϣ���ͳɹ�";

}catch (Exception e){

return "��Ϣ����ʧ��";

}

}

3.4 KafkaConsumer.Class

/**

* ������Ϣ,����һϵ��topic����Ϣ

* @param record

*/

@KafkaListener(topics = {"test","kafkatest"})

private void consumerMessage(ConsumerRecord<, > record) {

Optional<> kafkaMessage = Optional.ofNullable(record.value());

if (kafkaMessage.isPresent()) {

Object message = kafkaMessage.get();

log.info("----------------- ���ص���Ϣ����:{}",record);

log.info("------------------�յ���message:{}",message);

}

}

3.5 kafka.html

<!DOCTYPE html>

<html lang="en">

<head>

<meta charset="UTF-8">

<title>kafkaҳ��</title>

</head>

<body>

<form action="http://127.0.0.1:8899/kafka/sendMessage" method="post">

����:<input type="text" name="topic"/><br>

��Ϣ:<input type="text" name="message"/><br>

<input type="submit" value="����"/>

</form>

</body>

</html>

3.6 ������KafkaApplication

package com.mlsama.kafka;

import org.springframework.boot.Banner;

import org.springframework.boot.SpringApplication;

import org.springframework.boot.autoconfigure.SpringBootApplication;

@SpringBootApplication

public class KafkaApplication {

public static void main(String[] args) {

/** ����SpringApplicationӦ�ö��� */

SpringApplication springApplication =

new SpringApplication(KafkaApplication.class);

/** ���ú��ģʽ(���ùر�) */

springApplication.setBannerMode(Banner.Mode.OFF);

/** ���� */

springApplication.run(args);

}

}

ֱ������������,����: http://127.0.0.1:8899/index

4 kafka tool

Kafka tool�ṩһ������,����ֱ�۵Ŀ���kafka��Ⱥ����Ϣ,����topic,partition,���͵���Ϣ��.

���ص�ַ��http://www.kafkatool.com/download.html ����ֻ��2���汾,��Ϊ��װ��kafka�汾��2.1.0,��������Windows���2.0.3.��װ��ɵ��ʽ�ĵ�.��һ�δ�kafka tool����ʾ��������kafka ��Ⱥ.���ȷ�Ϻ�,��������:

������,���test,��ʾ���ӳɹ���,���add

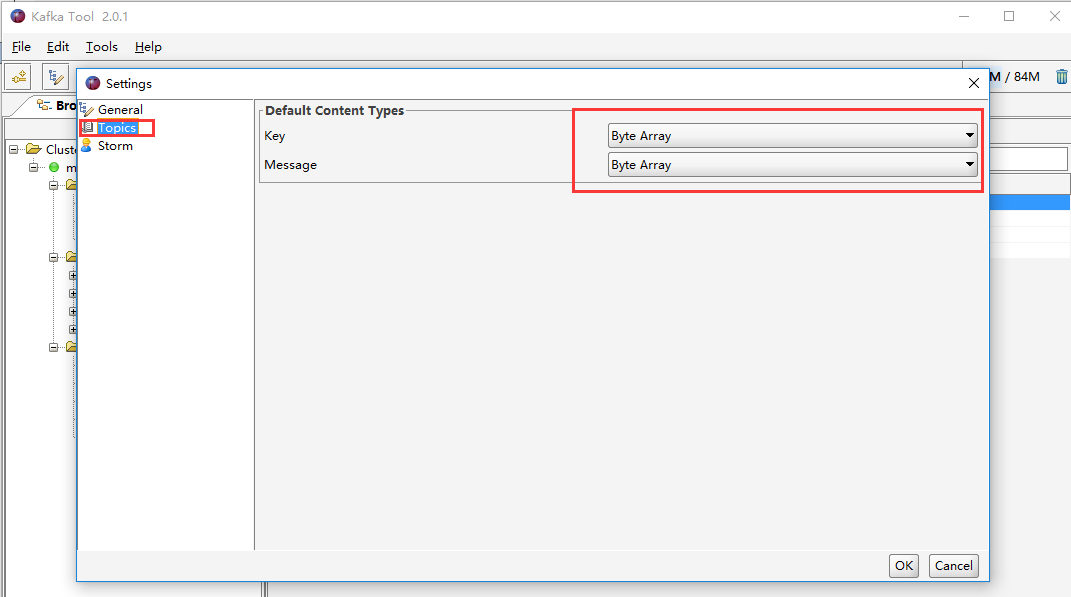

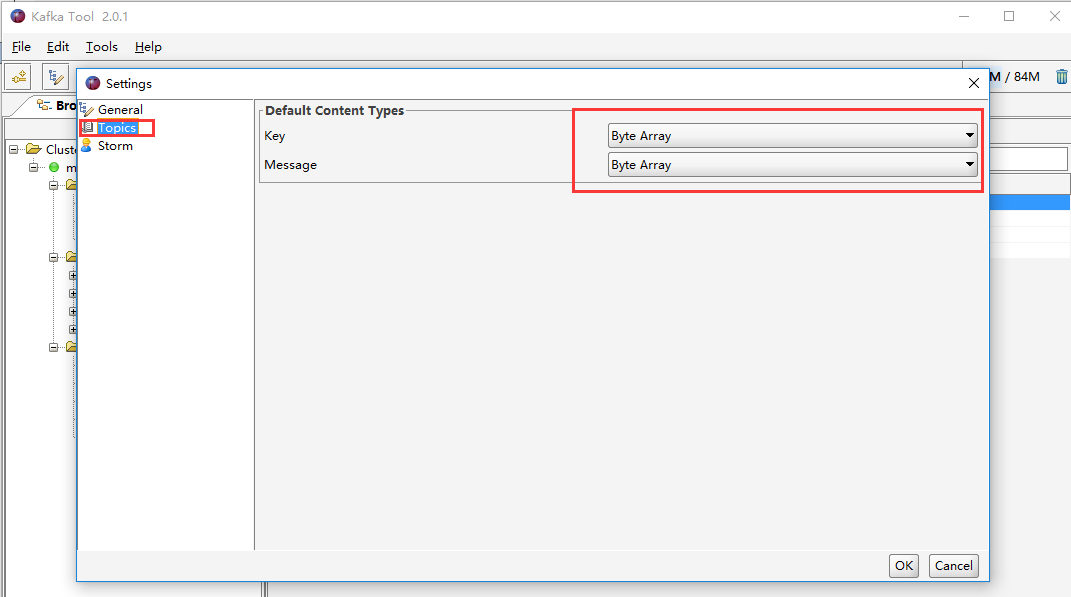

������Ϣ��String��ʾ:

Tool---setting,���topics,���ұߵ�key��message����ΪString����.

�鿴kafka������: