ǰ��

�������ҽ��ܵ���Python��ȡ�������ݣ����������Ҫ��С����Ǵ��룬���Ҹ���һ��С�ĵá�

��������ȡ֮ǰӦ�þ�����αװ�������������ʶ����������棬�������Ǽ�����ͷ�����������Ĵ��ı�������ȡ���˻�ܶ࣬����������Ҫ���Ǹ�������IP�������������ͷ�ķ�ʽ�����������ݽ�����ȡ��

��ÿ�ν����������ı�д֮ǰ�����ǵĵ�һ��Ҳ������Ҫ��һ�����Ƿ������ǵ���ҳ��

ͨ���������Ƿ�������ȡ�������ٶȱȽ������������ǻ�����ͨ�����ùȸ������ͼƬ��java script�ȷ�ʽ����������ȡ�ٶȡ�

��������

Python�汾�� 3.6

���ģ�飺

requestsģ��

reģ��

timeģ��

bs4ģ��

tqdmģ��

contextlibģ��

�����

��װPython�����ӵ�����������pip��װ��Ҫ�����ģ�鼴�ɡ�

�����������뼰�ļ����������Ի�ȡ

˼·����

������д�����Ҫ��ȡ��ҳ��

��F12���뿪���߹��ߣ��鿴������Ҫ����������������

����������Ҫҳ�����ݾͿ�����

���Ӵ���

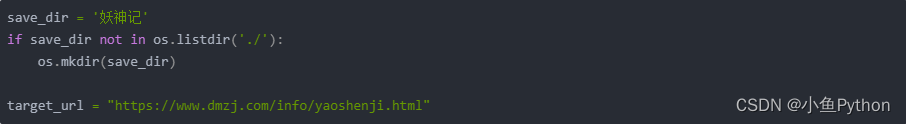

�������ش���ʵ��

# ��������

for i, url in enumerate(tqdm(chapter_urls)):

print(i,url)

download_header = {

'Referer':url,

'User-Agent':'Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/84.0.4147.105 Safari/537.36'

}

name = chapter_names[i]

# ȥ��.

while '.' in name:

name = name.replace('.', '')

chapter_save_dir = os.path.join(save_dir, name)

if name not in os.listdir(save_dir):

os.mkdir(chapter_save_dir)

r = requests.get(url=url)

html = BeautifulSoup(r.text, 'lxml')

script_info = html.script

pics = re.findall('\d{13,14}', str(script_info))

for j, pic in enumerate(pics):

if len(pic) == 13:

pics[j] = pic + '0'

pics = sorted(pics, key=lambda x: int(x))

chapterpic_hou = re.findall('\|(\d{5})\|', str(script_info))[0]

chapterpic_qian = re.findall('\|(\d{4})\|', str(script_info))[0]

for idx, pic in enumerate(pics):

if pic[-1] == '0':

url = 'https://images.dmzj.com/img/chapterpic/' + chapterpic_qian + '/' + chapterpic_hou + '/' + pic[

:-1] + '.jpg'

else:

url = 'https://images.dmzj.com/img/chapterpic/' + chapterpic_qian + '/' + chapterpic_hou + '/' + pic + '.jpg'

pic_name = '%03d.jpg' % (idx + 1)

pic_save_path = os.path.join(chapter_save_dir, pic_name)

print(url)

response = requests.get(url,headers=download_header)

# with closing(requests.get(url, headers=download_header, stream=True)) as response:

# chunk_size = 1024

# content_size = int(response.headers['content-length'])

print(response)

if response.status_code == 200:

with open(pic_save_path, "wb") as file:

# for data in response.iter_content(chunk_size=chunk_size):

file.write(response.content)

else:

print('�����쳣')

time.sleep(2)

���ݱ���

���չʾ

���

����ķ���������ͽ����� ������Ȥ������Ҳ����ȥ���Թ�

������������ģ���������������python�����⣬���������������Ի���˽����Ŷ

�����ҷ��������²����Ļ������Թ�עһ���ң����߸����µ���(/�R���Q)/