leSizeЪ§ОнДцШыЕНСаБэжа

НјНзаДЗЈ

page_uri_list = [[data["picPath1"], data["videoPath1"], data["address"] ] for data in data_list] #ДгJsonжаЖСШЁШ§жжЪ§ОнЃЌвддЊзщЕФаЮЪНБЃДцНјСаБэ

static_uri_path.extend(page_uri_list)#дкwhileбЛЗжаЃЌКЯВЂЕНвЛИіећЬхСаБэжа

for index, (img_uri, video_uri, address) in enumerate(static_uri_path , start=index_):

#static_uri_pathжагаШ§ИідЊЫиЃЌЗжБ№ЖСШЁ

#МгШыindexађСабЛЗ

#startПЩвдЩшЖЈГѕЪМжЕ

if img_uri is not None :

abs_img_path = os.path.join(imgs_path, f"{d_date.split('-')[0]}_{d_date.split('-')[1]}_{d_date.split('-')[2]}_{index}.jpeg")

request_file(img_uri, abs_img_path)

print(abs_img_path)

if video_uri is not None and IS_VIDEO:

abs_video_path = os.path.join(videos_path, f"{d_date.split('-')[0]}_{d_date.split('-')[1]}_{d_date.split('-')[2]}_{index}.mp4")

request_file(video_uri, abs_video_path)

XpathТЗОЖЖСШЁЕФвЛаЉЯрЙиВйзї

headers = {

"Cookie": abs_cookies,

"User-Agent": UA

}

response = requests.get(f"http://219.239.221.20:8088/cffm20/Monitoring/Details/{imageId}", headers=headers).text

tree = etree.HTML(response)

mar_b_10_div = tree.xpath('//div[@class="pad_15 jbxx_section"]/div[@class="clearfix mar_b_10"]')

#бЁШЁЫљгаdivдЊЫиЃЌЪЧгЕга"pad_15 jbxx_section"classЪєадЕФdivдЊЫижаЕФгЕга"clearfix mar_b_10"classЪєадЕФЫљгаdivдЊЫи

img_url = mar_b_10_div[1].xpath("./div[2]/a/@href")[0]#зюКѓетИі[0],МгЕФЛАЪЧЖСШЁСаБэжадЊЫиЃЌВЛМгЕФЛАЪЧИіСаБэ

txt_url = mar_b_10_div[2].xpath("./div[2]/a/@href")[0]

#./ЪЧЕБЧАФПТМЃЌЕБЧАФПТМЯТЕк2ИіdivдЊЫиЃЌdivжаЕФaдЊЫи,ШЛКѓбЁШЁaдЊЫижаЫљгаЕФhrefЪєад

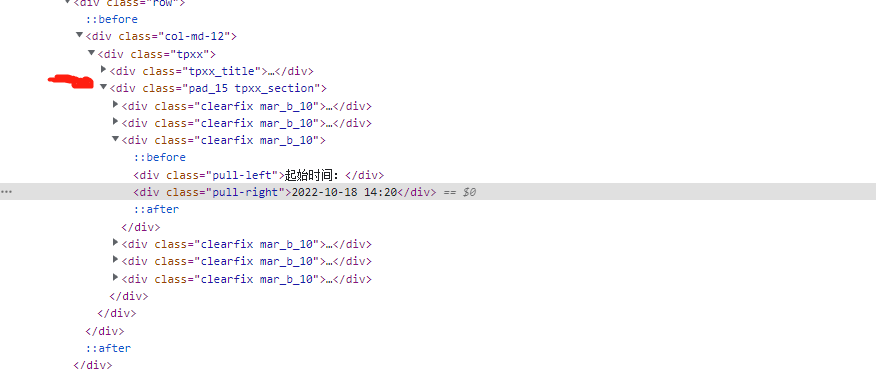

clearfix_mar_b_10_div = tree.xpath('//div[@class= "pad_15 tpxx_section"]/div[@class = "clearfix mar_b_10"]')

file_date = clearfix_mar_b_10_div[3].xpath("./div[2]/text()")[0] #text()ПЩвдЛёЕУ><жЎМфЕФБъЧЉЃЌ