: "北"

}

}

}

补充:

- 上面说了“分词器通常由分解器tokenizer和词元过滤器token filter组成。”,所以其实我们也可以自己通过组合分解器和过滤器来成形成一个分词器。这里有兴趣自查的。【有可能后面某天会补充】

- 上面提到了中文分词器,其实这已经涉及到了“插件”的内容了,这个内容会后面的篇章再讲。

小节总结:

本节重新解释了分词器的作用(字符过滤,词转换,词拆分),介绍了几种常见的内置的分词器(standard,english这些),并举了一些分词的例子,以及如何修改字段的分词器(mapping的analyzer),最后还介绍了怎么安装支持中文分词的ik分词器。

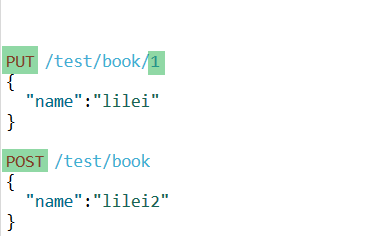

文档的ID

文档的ID其实是可以不指定的,不指定的时候会随机生成唯一的一串字符串,

手动指定和不指定的区别:

手动指定通常适用于一些将数据库的数据转存到ElasticSearch的场景,因为这时候ID有特殊意义,让数据库的数据与ElasticSearch的数据关联起来,(有时候可能需要同时查数据库和ElasticSearch,那么可以直接根据数据库中的ID来查ElasticSearch中的数据)。

不指定的时候(这时候通常ID是没有特殊意义的),ElasticSearch会自动地帮我们生成一个ID值,自动生成的ID长度为20个字符,这个ID它能确保是不会重复的,就算是在分布式并发情况下也不会发生冲突。【由于此时的ID是随机字符串,所以根据ID来查询数据会比较麻烦】

这里讲的还是比较偏应用方面的基础知识,后面可能还会补充偏底层的一些基础知识,比如底层写入流程和NRT这些。